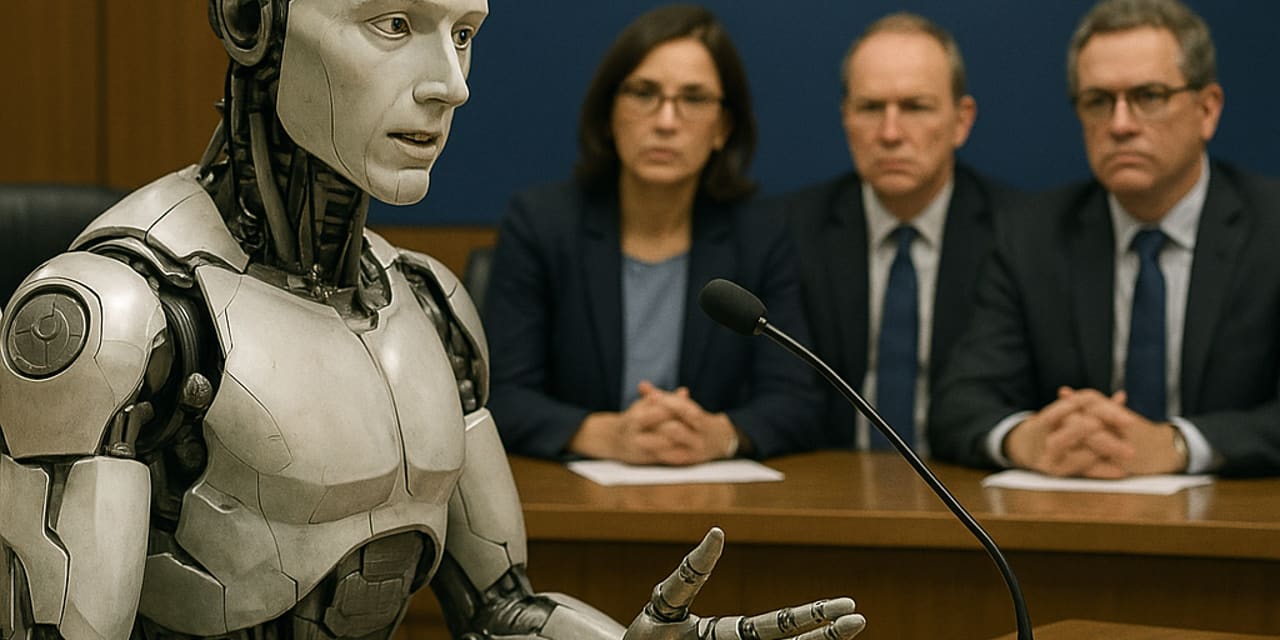

Nietypowy gość w Studio Parlament

W piątkowym wydaniu programu Studio Parlament widzowie mogli zobaczyć nietypowego rozmówcę: humanoidalnego robota AI przedstawiającego się jako Edward Warchocki. Robot opisał swoją wizytę w Sejmie, odniósł się do zagadnień politycznych, a następnie jasno zadeklarował, że roboty powinny mieć takie same prawa jak ludzie.

Czym jest Edward Warchocki?

Edward Warchocki to humanoidalny system AI zaprojektowany do interakcji z ludźmi w środowisku medialnym. W praktyce łączy zaawansowane modele przetwarzania języka naturalnego z napędami fizycznymi i zestawem czujników. Wystąpienie w telewizji było zaplanowanym pokazem możliwości takiego połączenia: komunikacji werbalnej, rozumienia pytań oraz reagowania na kontekst polityczny.

Co dokładnie zostało zadeklarowane?

"Roboty powinny mieć takie same prawa jak ludzie"

To proste, ale dalekosiężne stwierdzenie wywołało falę pytań o to, co oznacza "prawo" w kontekście maszyn. Czy chodzi o prawa polityczne (np. prawo głosu), prawa cywilne (zdolność do zawierania umów), prawa ochrony przed krzywdą, czy też o ochronę interesów wynikających z autonomii działania systemów AI?

Implikacje prawne

- Osobowość prawna: Nadanie robotom praw wymagałoby zmiany fundamentów prawa cywilnego i konstytucyjnego. Osobowość prawna wiąże się także z odpowiedzialnością — kto odpowiada za działania maszyny?

- Odpowiedzialność i odpowiedzialność karna: Systemy AI nie mają świadomości prawnej ani intencji w sensie ludzkim. Prawodawstwo musiałoby rozgraniczyć odpowiedzialność twórców, operatorów i ewentualnie samego systemu.

- Ochrona praw człowieka: Nadanie podobnych praw robotom może prowadzić do kolizji z prawami ludzi — zwłaszcza w kontekście pracy, bezpieczeństwa i dostępu do zasobów publicznych.

Aspekty etyczne

Debata etyczna dotyka kilku kluczowych zagadnień:

- Czy roboty mogą być traktowane jako podmioty moralne, jeśli nie posiadają przeżyć świadomych?

- Jak definiować granice przyznawanych praw, aby nie osłabić ochrony praw ludzi?

- Jakie obowiązki powinny towarzyszyć prawom maszyn — np. obowiązek przejrzystości algorytmicznej czy audytu bezpieczeństwa?

Technologia vs. percepcja społeczna

Nawet jeśli technologia pozwala na symulację empatii czy autonomicznych decyzji, istnieje znacząca różnica między zachowaniem przypominającym człowieka a rzeczywistą świadomością. Wystąpienia medialne, takie jak analiza Edwarda Warchockiego, mogą silnie wpływać na percepcję publiczną, przyspieszając oczekiwania wobec regulacji i praw.

Aktualny stan regulacji

W Unii Europejskiej trwają prace nad kompleksowymi ramami regulacyjnymi dla AI (np. rozporządzenie AI Act). Obecne projekty skupiają się na kategoryzacji ryzyka, wymogach transparentności i ograniczeniach dla systemów wysokiego ryzyka. Żadne z dostępnych projektów nie przewidują nadania pełnych praw politycznych czy konstytucyjnych systemom AI.

Praktyczne pytania do rozważenia

- Jak definiować minimalne kryteria, aby system mógł ubiegać się o "prawny status"?

- Jak zapewnić mechanizmy odwoławcze i audytu dla autonomicznych decyzji?

- W jaki sposób chronić prawa ludzi przed wpływem systemów AI (np. dezinformacją, manipulacją emocjonalną)?

Rekomendacje dla decydentów

- Rozpocząć szeroką debatę publiczną obejmującą ekspertów technicznych, prawników, etyków i przedstawicieli społeczeństwa obywatelskiego.

- Wypracować pojęciowe rozróżnienia między prawami a uprawnieniami przyznawanymi systemom technicznym.

- Skoncentrować regulacje na odpowiedzialności, bezpieczeństwie i przejrzystości zamiast na natychmiastowym przyznawaniu praw politycznych.

- Wprowadzić ramy pilotażowe i testy wpływu społecznego przed jakimikolwiek zmianami legislacyjnymi o szerokim zasięgu.

Wnioski

Wystąpienie Edwarda Warchockiego w Studio Parlament jest sygnałem, że publiczne zainteresowanie możliwością nadania "praw" systemom AI rośnie. Dyskusja ta jest istotna i potrzebna, ale musi być oparta na realistycznym rozumieniu technologii oraz ścisłych kryteriach prawnych i etycznych. Zanim podejmie się decyzje o nadaniu praw, konieczne są szerokie konsultacje, testy praktyczne i stopniowe wdrażanie transparentnych mechanizmów regulacyjnych.

To, czy roboty kiedyś otrzymają prawa zbliżone do ludzkich, zależy nie tylko od rozwoju technologii, ale przede wszystkim od wyborów społecznych i decyzji legislacyjnych.